Narrative Clipで綴る一日

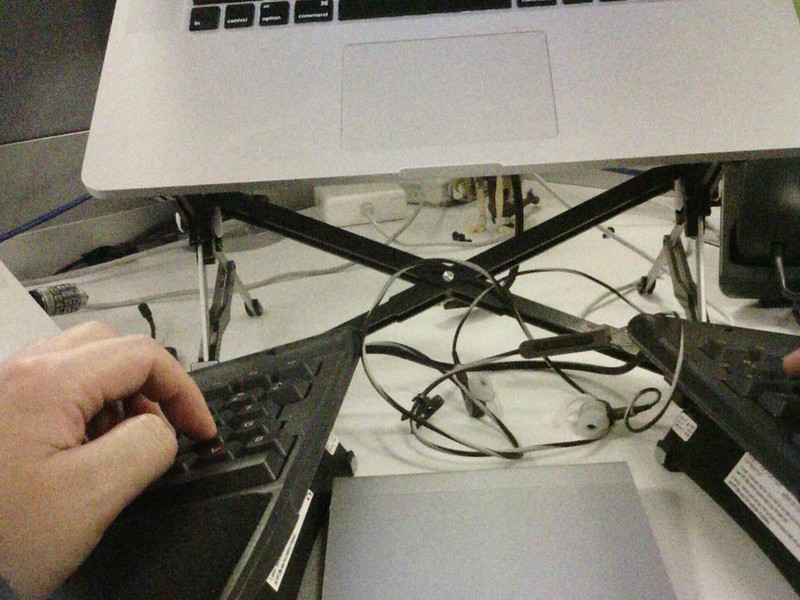

Narrative Clip自体に基本的に操作することは無いので、使い方としては、朝起きたら、クリップで洋服に装着して生活するだけなのですが、毎日寝る前にNarrative ClipをMacに接続します。

これには二つの意味があって、一つはNarrative Clip自体の充電。もう一つがデーターの処理です。

ここら辺出来るだけ手間をかけないようにNarrative Clipは良く出来ていて、ほんとMacにUSBで接続するだけで、Macにインストールした常駐アプリがNarrative Clipを自動的に認識して、

- データーをMacにコピー

- データーをNarrativeサーバーにアップロード

- Narrativeサーバー側でデーターを処理してMomentを生成

という処理を一括して行ってくれます。

一旦データーをMac側にコピーするのは意味があって、30秒毎、一日中写真を撮影してるわけですから、データー量は毎日1GBを超えます。これを直接Narrative Clipからアップロードしてると、その間Narrative ClipをMacから外せなくなってしまいます。

最初にデーターだけ全部コピーしてしまえば、後はNarrative Clip自体は自由に出来るので、使い勝手が良くなります。また、このMac側にコピーされたデーターは、標準ではNarrative側のクラウドにアップロードが完了すると消されますが、保存するオプションも選択することが出来ます。

実際には、寝る前にNarrative ClipをMacに接続するときに本体の充電も兼ねているので、Mac側にコピーが終わったらすぐにMacから外すと言うことはあまりないと思いますが、とはいえ、デバイスが拘束されないのは良いことです。

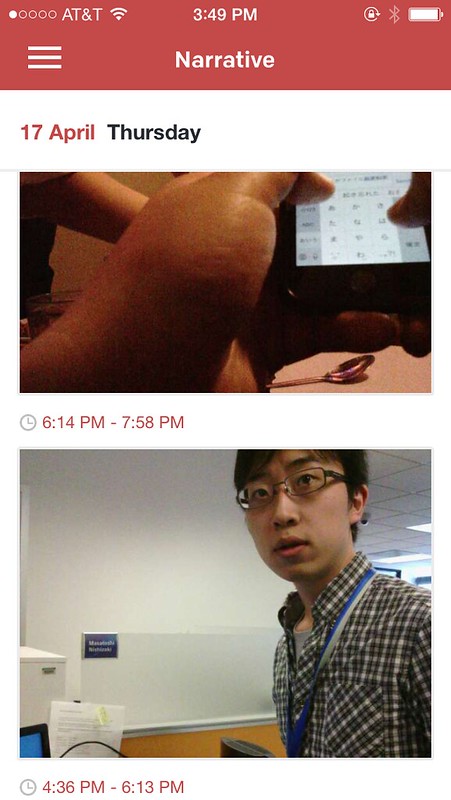

で、データーがサーバーにアップロードされると、最後にNarrativeサーバー側でMomentと呼ばれる、一日のイベント単位のクリップのようなものが生成され、iOSなどのクライアントアプリでその日の活動が見れるようになります。(↑の写真)

逆に言うと、3の処理が終わるまでは、撮影したデータをみることが出来ません。この3の処理がまさにNarrativeクラウドの秘密のレシピというか彼らの腕の見せ所という感じなのですが、結構処理が大変なようで、タイミングが悪いと、僕の場合、一番時間かかったときは最長6時間くらいデーターの生成に時間がかかることがありました。ここら辺は負荷との兼ね合いだと思うのですが、通常は数分くらいでデーターが見えるようになります。

ということで、基本ルーチンとしては、

- 朝起きてNarrative Clipを装着する

- 夜寝る前にNarrative ClipをMacにUSB接続し充電+データー転送する

- 翌朝、前日のログをiOSアプリで確認する

みたいな流れになると思います。

ということで、前置きが長くなりましたが、2014年4月17日の僕の生活を覗いてみましょう。

とりあえず朝起きて最初の写真はこんな感じ。とりあえず起きたら即、寝ぼけ眼のままMacに直行してNarrative Clipを装着です。

ガレージでの様子。最近朝プールにハマっていて、朝6時30分くらいに起床してジムのプールに向かいます。

ジムは家から車で3分くらいなので、すぐに到着。これはジムのロッカーの写真ですね。流石にNarrative Clipは防水では無いので、水泳中はログが取れませんw

30分くらい泳いで、その後10分くらいサウナに入り、ガッツリ汗をかいた後に、ジムのカフェで朝食を食べるのが最高に気持ちいい。ハマります。

朝食を食べながら\backspace.fm\ #017回の編集をしてるのが分かりますね。

有意義な朝の時間を過ごして会社に向かいます。

この日は朝一から会議の日だったので、早速会議を行ってますね。

そのまま会議が午後まで続くので、会議室でランチを食べてる様子。

ようやく自分のデスクに戻ってお仕事開始。

基本的に日中の仕事中はずーーーーっとこの写真が写されてる感じですw

午後にまたショートミーティングで会議室に移動した様子が思い出されます。

最近ブロガーとしても開花をしはじめている @west_zaki とテリーと三人でオフィス近くのカフェで午後の一休み。

その後、オフィスに戻り @west_zaki としばし仕事の相談など。

その後また、延々とこの風景が続きます。。。

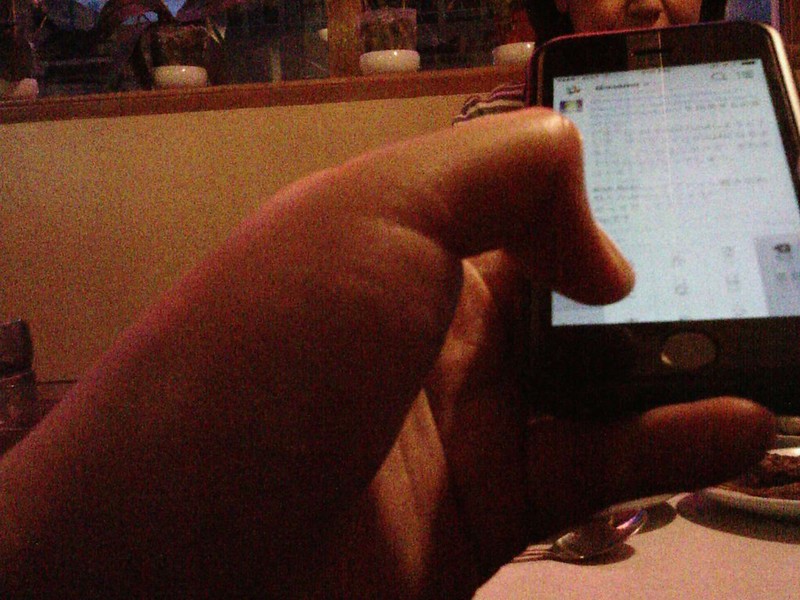

仕事も終わり、この日は @kurobozu もオフィス近くに用事があったので、合流して久々にスンドゥブを食べに韓国レストランへ直行。

待っている間にiPhoneしてる様子もバッチリ捕捉されてますね。

会議中とかにサボってFacebookとかやってると全部捕捉されてしまうので注意ですw

いやぁ、久々のスンドゥブ美味しかった!

その後、帰宅してすぐ歯を磨いていた様子。

で、その後ソファーでマッタリテレビを観てたんですが、そのまま寝落ちしてしまって、その間撮られていたのがこの天井写真。

他人がみたときには、なんじゃこりゃな写真が多いかもしれませんが、Narrative Clip恐るべしなのは、そんな「なんじゃこりゃ写真」でも自分がみると、その時に何をしていたのか大体思い出せるんですよね。まさにライフログの醍醐味。

もちろんこれらの写真は超超抜粋で、実際にはこの100倍以上の写真が撮られてるわけですが、ほんとに一日のすべてが記録されてる感じはありますね。

ただ、最大の問題は、やっぱりこれらデーターをどうやって閲覧して、活用していくかという所だということもよく分かりました。

Narrative Clipもサーバー側でデーターを解析したり、無駄な写真を排除するような努力をしていますが、それでも一つ一つのタイムラインを追っていくのは無理がありすぎる。

せめてPC版のクライアントがあって、もっと大量にデータを閲覧できればいいんですが、まぁ、それでも焼け石に水感は否めませんね。

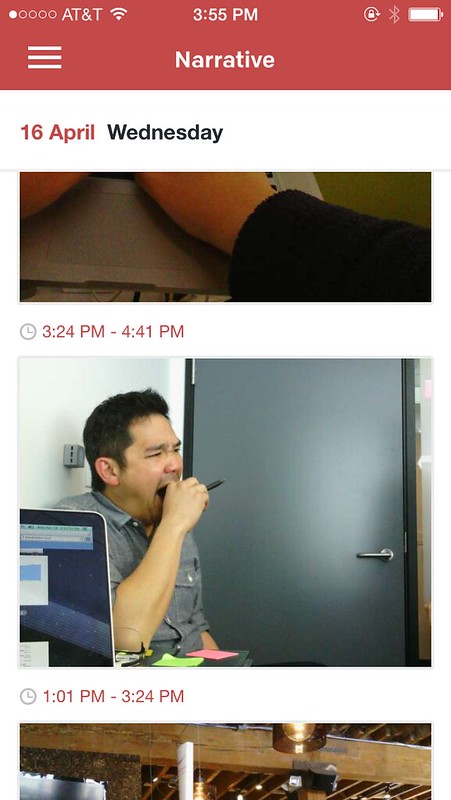

ということで、やっぱり期待すべきはデータの解析技術の向上ですかね。実際↑の写真みたいに、Narrativeサーバー側で解析が終わって、iOSアプリで閲覧するときは、いい感じに写真がイベントとして分割され、かつ、それぞれのイベントのなかで特徴のある写真を自動で抽出してタイムラインを生成してくれます。

この精度がもっともっと上がって、かつ閲覧性が向上したらもっと利用価値が増えるかもしれません。

おまけ

一個おまけで、Narrative Clipが自動的に抽出した写真をご紹介。Kenjiさんが会議中に油断した一瞬をNarrative Clipが捉えただけでなく、それを解析したデータが特徴画像として抽出してるのが素晴らしいです!

データの解析や見せ方には無限の可能性があるので、今後のますますの進化に期待したいです!

(注) 一応注訳しておくと、本文中に登場する @west_zaki さんやKenjiさんには写真をブログに使ってよいか事前に確認を取ってあります。お二人とも快諾感謝です!